美东时间周二,谷歌发布了一项名为TurboQuant的超高效AI内存压缩算法,该算法在不损失准确性的前提下,将大型语言模型运行时的缓存内存占用至少减少6倍、性能提升8倍。这项技术让人工智能在占用更少内存空间的同时记住更多信息。算法一经发布,美股芯片股应声下跌,引发了关于是否可以终结当前困扰众多科技巨头的内存芯片短缺问题的讨论。

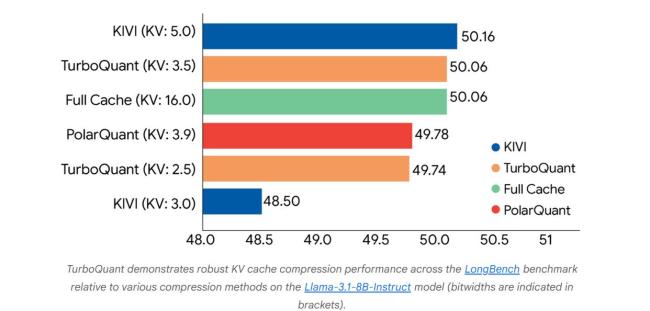

TurboQuant是一种压缩方法,它能在保持精度的前提下大幅减小模型大小,非常适合支持键值缓存(KV Cache)压缩和向量搜索。通过两个关键步骤实现这一点:首先,使用PolarQuant方法随机旋转数据向量,简化数据几何结构并应用高质量量化器;其次,使用QJL算法消除第一阶段遗留的微小误差,提高准确性。简单来说,TurboQuant在保持AI模型核心结构不变的情况下压缩AI模型,无需预处理或特定校准数据。

谷歌使用开源长上下文模型(Gemma和Mistral)在多项基准测试中对TurboQuant进行了评估,实验数据显示,TurboQuant在点积失真和召回率方面均达到最优评分性能,同时最大限度地减少了键值内存占用。谷歌计划在ICLR 2026会议上展示研究成果及其两种压缩方法:量化方法PolarQuant和训练优化方法QJL。

这一算法让人联想到HBO电视剧《硅谷》中的虚构创业公司Pied Piper开发的突破性压缩算法。现实中的TurboQuant同样致力于在不损失质量的前提下实现极致压缩,应用于人工智能系统的核心瓶颈。Cloudflare首席执行官Matthew Prince等人甚至称之为谷歌的DeepSeek时刻,认为其有望通过极高的效率收益大幅降低AI的运行成本,同时保持竞争力。

特别声明:以上文章内容仅代表作者观点,不代表本站观点或立场。如有关于作品内容、版权或其它问题请于作品发表后与我们联系。

头条今日_全国热点资讯网(头条才是今日你关心的)

头条今日_全国热点资讯网(头条才是今日你关心的)